La tecnologia e la scienza stanno semplificando qualunque aspetto della nostra vita, ma se c'è una cosa che rimane ancora difficilissima quella cosa è stare sul pezzo. Il 2018 sarà un anno cruciale per tantissimi ambiti che non hanno, il più delle volte, direttamente a che fare con la nostra vita, ma che la influenzeranno radicalmente nel futuro prossimo.Per questo motivo abbiamo deciso di creare La Guida di Motherboard al 2018, una serie di articoli introduttivi su quelli che, per noi, saranno i temi più importanti dell'anno. Così al prossimo pranzo di famiglia non fate brutta figura, non ringraziateci.

Pubblicità

Le elezioni americane del 2016 hanno scoperchiato il vaso di Pandora, segnando definitivamente uno spartiacque per le democrazie di tutto il mondo. Le informazioni e le analisi svolte durante tutto il 2017 hanno aggiunto tasselli che definiscono un quadro sempre più drammatico: il processo delle elezioni democratiche è stato oggetto di un attacco da parte della Russia.Tutto questo è avvenuto sfruttando strategie di disinformazione online e approfittando delle piattaforme social che fino ad ora erano rimaste a guardare, interessate solamente ai propri profitti ed abbagliate dai loro ideali tecnocratici di risollevare le sorti del mondo.Secondo i dati riferiti da Facebook al Congresso americano, 146 milioni di utenti Facebook e Instagram hanno visto online contenuti prodotti da account russi. I contenuti utilizzati sfruttavano il sistema di pubblicità di Facebook, che permette di presentare post sponsorizzati solamente a fette specifiche della popolazione, individuate secondo dei parametri selezionabili — per questo motivo si parla anche di dark ads.Il pericolo di interferenze da parte della propaganda russa è stato citato anche nei casi delle elezioni tedesche e francesi, e nel referendum britannico.

Immagine: Numero1Studio

Attualmente, quindi, il mondo intero è in stato di allerta poiché gli spazi online dei social network sono stati militarizzati e trasformati in armi in modo inaspettato, subendo lo stesso trattamento riservato alla rete internet che ora è diventata un campo di battaglia per una guerra cibernetica costante.

Pubblicità

Il dibattito riguardo le fake news ha già segnato profondamente la fiducia nei media da parte del pubblico, e grazie al lavoro costante di giornalisti e ricercatori che hanno sottolineato i pericoli dell’utilizzo di un termine così vago — si dovrebbe infatti differenziare fra informazioni deliberatamente false (disinformazione) e informazioni involontariamente errate (misinformazione) — stiamo riuscendo solamente ora a districarci un po’ meglio all’interno dell’inquinamento informativo che ci investe quotidianamente.Allo stesso tempo, però, gli strumenti tecnologici utilizzati per disseminare questi contenuti hanno acquisito un ruolo sempre più centrale per capire le strategie e le azioni politiche, al punto da meritarsi un nome specifico: propaganda computazionale.

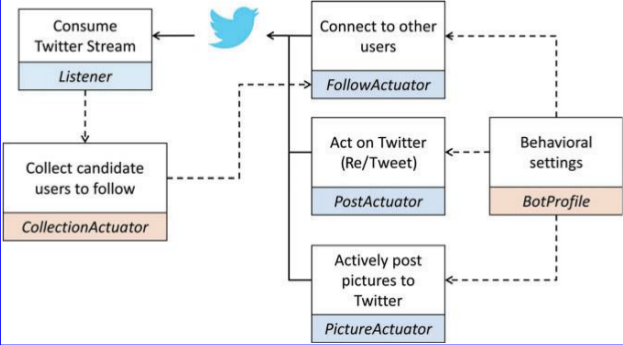

Secondo la definizione riportata dal Computational Propaganda Project dell’Oxford Internet Institute, la propaganda computazionale prevede l’impiego di algoritmi e automazione per apprendere e simulare il reale comportamento umano in modo da manipolare l’opinione pubblica attraverso un ampio ventaglio di canali, piattaforme, e network di dispositivi.L’automazione introdotta dagli algoritmi di intelligenza artificiale — la stessa che genera la paura per la perdita di posti di lavoro di milioni di lavoratori — permette ora di creare dei bot in grado di interagire e compiere semplici attività sui social network passando spesso inosservati sia agli occhi degli utenti reali che, a volte, di quelli dei gestori delle piattaforme.La propaganda computazionale prevede l’impiego di algoritmi e automazione per apprendere e simulare il reale comportamento umano in modo da manipolare l’opinione pubblica attraverso un ampio ventaglio di canali, piattaforme, e network di dispositivi.

Pubblicità

I bot sono quindi parte integrante della propaganda computazionale, necessari per la diffusione rapida e capillare di disinformazione e, come sottolineato nel manifesto dei bot ideato da alcuni ricercatori dell’istituto Data & Society, è pericoloso lasciare che interferiscano nelle decisioni delle persone: “non vogliamo che soggetti automatizzati influenzino indebitamente le scelte di voto.”

LA PROPAGANDA NON È SOLO BOTIl 9 agosto 1918, Gabriele D’Annunzio sorvolò con 11 aerei la città di Vienna, lanciando 400.000 copie di un manifesto di propaganda che esortava gli austriaci alla resa. La prima guerra mondiale ha infatti visto un ampio uso degli aeroplani per diffondere documenti e volantini per plasmare l’opinione pubblica; questa pratica risale sicuramente almeno al IXX secolo, quando durante la guerra franco-prussiana vennero lanciati dei volantini su Parigi sfruttando dei palloni aerostatici.La consacrazione definitiva della propaganda aerea, però, è avvenuta nella seconda guerra mondiale da parte di entrambi gli schieramenti: durante la guerra del Pacifico, ad esempio, gli americani lanciarono volantini sul Giappone invitando i cittadini a lasciare le proprie abitazioni e i tedeschi lanciarono volantini sul continente europeo per scoraggiare le truppe nemiche.

La propaganda, però, non è solamente rivolta ai nemici e molto spesso infatti i governi la utilizzano sui i propri cittadini. Il Ministero del Reich per l'istruzione pubblica e la propaganda, guidato da Joseph Goebbels, aveva il compito di monitorare il giornalismo, la letteratura, le arti, la cinematografia e la radio. L’intento era quello di rafforzare il culto della personalità di Adolf Hitler, diffondere l’anti-semitismo e l’ideologia nazista. Parallelamente, anche l’Italia fascista introduce il Ministero della Cultura Popolare, con il compito di legittimare l'ideologia e il regime fascista.

Pubblicità

Se con il lancio dei volantini dal cielo la possibilità di raggiungere tutti i cittadini risultava più complicata, con il controllo completo della stampa, della radio e del cinema, la diffusione della propaganda diventava capillare. La comunicazione di massa si trasforma così in mezzo di propaganda nelle mani dello Stato.Le forme di propaganda vengono riconosciute anche come vere e proprie strategie militari, sfruttate per ottenere scopi peculiari: un esempio eclatante è la cosiddetta dezinformatsiya utilizzata dall’Unione Sovietica.

Si tratta di un’azione coordinata dallo Stato per disseminare informazioni false o ingannevoli alla stampa di determinati stati e regioni. Come ricorda un’analisi dell’istituto Data & Society, questa pratica rientra nel concetto di misure attive, un termine che include “una varietà di tecniche usate per minare e disgregare, in maniera strategica, le politiche e le relazioni dei governi che si oppongono all’Unione e allo stesso tempo rafforzare quelle degli alleati.”E proprio il termine militare information operations — l’uso strategico di tecnologie, operazioni, e risorse psicologiche per distruggere le capacità informative degli avversari — è stato utilizzato da Facebook per descrivere degli atti deliberati, compiuti da soggetti più o meno identificabili, che hanno l’obiettivo di manovrare l’opinione pubblica utilizzando account fasulli e informazioni inaccurate.I social network sono diventati ufficialmente un campo di battaglia e i bot sono gli eserciti che si scontrano.

Pubblicità

I social network sono diventati ufficialmente un campo di battaglia e i bot sono gli eserciti che si scontrano.CHI SONO I BOT?Lo scorso settembre, in un post sul blog ufficiale, Twitter ha ammesso di aver sospeso più di 117.000 “applicazioni malevole” nei precedenti 4 mesi. Secondo quanto riportato da Quartz, le stime più recenti indicano che il 50% del traffico su Twitter sia automatizzato.Questa ampia diffusione di account automatizzati ci conduce alla definizione di bot sociali, ovvero tutti quei bot in grado di interagire in modo più o meno automatizzato sui social network. Se in alcuni casi questi bot sfruttano le possibilità offerte dagli algoritmi di intelligenza artificiale per produrre conversazioni realistiche, molto più spesso ci troviamo di fronte ad account automatizzati in grado di compiere semplici attività, come @everycolorbot che twitta colori, oppure @congressedits e il suo corrispettivo italiano @ItaGovEdits, i quali monitorano le modifiche anonime alle pagine di Wikipedia effettuate da account riconducibili a indirizzi IP delle sedi del Congresso americano e della Camera, Senato, Presidenza del Consiglio e della Repubblica italiani.I bot possono essere utilizzati anche per condividere informazioni riguardo disastri naturali, come avviene con l’account @INGVterremoti che twitta dati raccolti dall’Istituto Nazionale di Geofisica e Vulcanologia sui fenomeni sismici — ricordando però che possono esserci dei bug nel software, come il 21 giugno del 2017 quando Quakebot ha notificato un terremoto di magnitudo 8.6 in California: si trattava di un errore dovuto semplicemente alla modifica in un database dei dati di un terremoto simile avvenuto nel 1925.

Pubblicità

Allo stesso tempo, però, proprio per la struttura stessa dei social network ed in particolare se pensiamo alle sezioni degli argomenti di tendenza, ci rendiamo conto che queste piattaforme sono dei sistemi computazionali che influiscono sulla circolazione dei contenuti. La propaganda computazionale può sfruttare questa infrastruttura per gonfiare l’attenzione su determinati argomenti, modificare la percezione dell’importanza stessa di alcuni temi, e generalmente manovrare la discussione pubblica.Secondo il Computational Propaganda Project, la propaganda computazionale non è utilizzata solamente dai regimi ma anche nelle democrazie troviamo esempi di candidati politici, campagne e lobbisti che affittano reti di account fasulli con il solo scopo di produrre contenuti propagandistici. Nel loro studio sottolineano anche che “la forma più potente di propaganda computazionale prevede sia una distribuzione algoritmica che l’intervento editoriale umano — bot e troll che lavorano insieme.”

In questo modo basta un piccolo gruppo di persone per sfruttare la potenza di un’armata di bot e dare l’impressione di un ampio consenso su un tema specifico.Secondo uno studio pubblicato dall’Oxford Institute a dicembre scorso, attualmente, un sistema ibrido che prevede l’uso di bot automatici per la disseminazione dei contenuti prodotti da editori umani è il sistema più efficace da un punto di vista dei costi ed è anche in grado di superare i meccanismi di controllo delle piattaforme social: lo studio, sfruttando sistemi di riconoscimento dei bot come BotOrNot, dimostra che è difficile distinguere fra forme ibride e utenti reali.

Pubblicità

Questi sistemi sono quindi utilizzati in ogni parte del mondo, sfruttando spesso metodologie peculiari, come ad esempio nel caso dell’Arabia Saudita, in cui le truppe di bot vengono utilizzate per “avvelenare gli hashtag” in modo da inondare con contenuti completamente scorrelati i temi di tendenza, soffocando così le critiche e le conversazioni indesiderate. Una pratica simile è attuata in Cina e prende il nome di xuanchuan e sfrutta, a volte, la cosiddetta 50 Cent Army: centinaia di migliaia di persone che, secondo quanto riportato, verrebbero pagate per ogni post che producono con lo scopo di sviare le conversazioni online.Secondo un recente report, è stato individuato l’utilizzo di bot per la propaganda computazionale in Argentina, Azerbaijan, Iran, Messico, Filippine, Russia, Corea del Sud, Siria, Turchia e Venezuela.A questa lista, come rivelato dal gruppo BigData42 alla conferenza e-privacy XXI dello scorso giugno, dobbiamo aggiungere l’Italia.

BOTNET ITALIANEA novembre 2015 il ricercatore Renato Gabriele rivela l’esistenza di una “botnet volontaria” utilizzata per gonfiare il numero di tweet in supporto agli hashtag lanciati da Matteo Salvini — in quell’occasione si trattava di #alfanodimettiti. Secondo i dati raccolti da Renato Gabriele, i primi 10 account producevano il 40% dei tweet complessivi.La botnet della Lega non era certamente il primo caso di propaganda computazionale utilizzato in Italia: BigData42 sottolinea infatti come già durante le elezioni italiane del 2013, ed in particolare nelle primarie di un partito, vi fossero dei bot in azione che manipolavano sia i commenti online che i sondaggi sui siti di notizie.

Pubblicità

Il 29 dicembre 2017, invece, il blogger e debunker David Puente aveva indicato l'azienda Isaydata come possibile responsabile di una botnet che riprendeva tweet di altri utenti reali — una pratica necessaria per mantenere attivi i bot e farli sembrare più autentici. I tweet ripresi riguardavano la restituzione delle case colpite dal sisma a L'Aquila.

Successivamente, Matteo Flora, esperto di sicurezza informatica, ha pubblicato un’analisi degli account utilizzati da questa botnet: 216 bot hanno prodotto circa 100.000 tweet.L’11 gennaio, però, questa stessa rete è stata attaccata da un gruppo di hacker che ne ha preso il controllo, iniziando a farle condividere tweet in cui Isaydata veniva smascherata definitivamente — gli hacker sarebbero riusciti ad introdursi in un server dell’azienda.

Al momento attuale, però, le strategie per combattere la propaganda computazionale sembrano ancora incerte. Prima di tutto, come sottolineano Samuel Woolley e Tim Hwang di Data & Society, sarà necessario decidere se sia la natura stessa dei bot ad essere problematica oppure solo le intenzioni e gli strumenti che i bot usano per raggiungere i loro obiettivi.Alcune soluzioni prevedono l’uso di reti di bot benevole per combattere i bot politici: si possono sia dirottare le loro azioni usando delle parole specifiche in grado di attirare l’attenzione di questi ultimi sia dare la caccia alla disinformazione online automatizzando l’attività di debunking.

Pubblicità

Altri sistemi, invece, cercano di ridurre l’impatto della propaganda fornendo strumenti agli utenti per monitorare la propaganda computazionale, inviando delle notifiche quando ci sono botnet in azione oppure fornendo un osservatorio per monitorare gli attacchi.

LEGGI DI PIÙ- Cosa sappiamo della 'rete di fake news' del Movimento 5 Stelle e della Lega Nord

- La botnet di Matteo Salvini colpisce ancora

- Come i bot hanno condizionato il risultato delle elezioni USA

Allo stesso tempo, i ricercatori stanno migliorando le tecniche automatizzate per il riconoscimento dei bot politici che si basano sull’analisi dell’attività giornaliera, dei pattern linguistici e dello studio dei comportamenti.Anche le piattaforme che sono diventate terreno fertile per la propaganda computazionale devono agire attivamente, sia fornendo ai ricercatori un maggiore accesso ai dati dei social network sia agendo attivamente al contrasto dei bot.Sarà necessario decidere se sia la natura stessa dei bot ad essere problematica oppure solo le intenzioni e gli strumenti che i bot usano per raggiungere i loro obiettivi.

LEGGI DI PIÙ- Cosa sappiamo della 'rete di fake news' del Movimento 5 Stelle e della Lega Nord

- La botnet di Matteo Salvini colpisce ancora

- Come i bot hanno condizionato il risultato delle elezioni USA

Allo stesso tempo, i ricercatori stanno migliorando le tecniche automatizzate per il riconoscimento dei bot politici che si basano sull’analisi dell’attività giornaliera, dei pattern linguistici e dello studio dei comportamenti.Anche le piattaforme che sono diventate terreno fertile per la propaganda computazionale devono agire attivamente, sia fornendo ai ricercatori un maggiore accesso ai dati dei social network sia agendo attivamente al contrasto dei bot.Sarà necessario decidere se sia la natura stessa dei bot ad essere problematica oppure solo le intenzioni e gli strumenti che i bot usano per raggiungere i loro obiettivi.

Il Presidente francese Emmanuel Macron ha recentemente proposto una legge contro la disinformazione online che mette gravemente in pericolo la democrazia, concedendo la possibilità di bloccare i siti internet durante le elezioni; la Germania ha introdotto una legge per contrastare l’odio online che si è subito rivelata controproducente, costringendo Twitter a bloccare erroneamente un account satirico; il Brasile ha recentemente annunciato delle misure straordinarie per il contrasto alle fake news, misure che non sono supportate da alcuna legge e che rischiano di minacciare gravemente la libertà di espressione nel paese — persino in Italia si era vociferato di una legge contro le fake news poi mai apparsa.Tutte queste misure, oltre ad essere nocive, sono completamente fuori fuoco rispetto al problema della propaganda computazionale. Il 4 marzo voteremo alle elezioni politiche e dovremo tenere a mente che l’opinione pubblica, i temi di discussione e le conversazioni online potrebbero essere inquinate da account automatici in grado di disseminare disinformazione con pochi click. Parafrasando una famosa vignetta del New Yorker, su internet nessuno può sapere che tu sei un bot.Nel frattempo, però, dovremmo stare attenti a tutti quei tentativi politici di contrastare le fake news e la propaganda con manovre che mettono a rischio la libertà di espressione.